KI und Vertrieb

Für wen lohnt sich lokale KI wirklich?

Kaum ein KI-Thema wird im Mittelstand gerade so heiß diskutiert wie lokale KI.

Inhaltsverzeichnis

- 01Wann lohnt sich lokale KI wirklich?

- 02Was ist lokale KI überhaupt?

- 03Wie ist der Stand lokaler KI wirklich?

- 04Warum das relevant ist

- 05Wo lokale KI wirklich Sinn ergibt

- 06Wo lokale KI eher keinen Sinn ergibt

- 07Der eigentliche Denkfehler vieler Unternehmen

- 08Warum das Thema gerade jetzt so relevant wird

- 09Unser Fazit aus der Praxis

Wann lohnt sich lokale KI wirklich?

Kaum ein KI-Thema wird im Mittelstand gerade so heiß diskutiert wie lokale KI.

Die einen tun so, als wäre Self-Hosting immer noch etwas für Nerds mit zu viel Freizeit. Die anderen tun so, als müsse ab morgen jedes Unternehmen seine komplette KI-Infrastruktur selbst betreiben.

Beides greift zu kurz.

Die Erfahrung aus unseren Kundenprojekten - in denen wir lokale KI-Modelle bereits unter anderem für Leadrecherche und Extraktionsaufgaben einsetzen - zeigt ein deutlich nüchterneres Bild:

Lokale KI ist weder Allheilmittel noch Spielerei. Sie ist dann sinnvoll, wenn der konkrete Use Case, die Datensensibilität und die technische Architektur zusammenpassen.

Die entscheidende Frage lautet deshalb nicht, ob lokale KI grundsätzlich gut oder schlecht ist.

Die sinnvollere Frage lautet:

Wann lohnt sich lokale KI wirklich - und wann eher nicht?

Was ist lokale KI überhaupt?

Mit „lokaler KI“ sind in der Regel öffentlich verfügbare KI-Modelle gemeint, die sich auf eigener Infrastruktur betreiben lassen.

Also zum Beispiel:

- auf einem eigenen Server

- auf einer dedizierten GPU-Maschine

- auf gemieteter Hardware

- oder teilweise sogar direkt auf leistungsfähigen Consumer-Geräten wie einem MacBook Pro

Wichtig dabei:

Ein offenes Modell ist nicht automatisch lokal betrieben.

Viele dieser Modelle lassen sich auch ganz normal über Cloudanbieter einkaufen - zum Beispiel über OpenRouter oder andere Inference-Anbieter.

Der Unterschied liegt also nicht nur im Modell selbst, sondern in der Infrastrukturfrage:

Läuft das Modell auf fremder Infrastruktur - oder auf eigener bzw. kontrollierter Hardware?

Genau dort wird es für Unternehmen interessant.

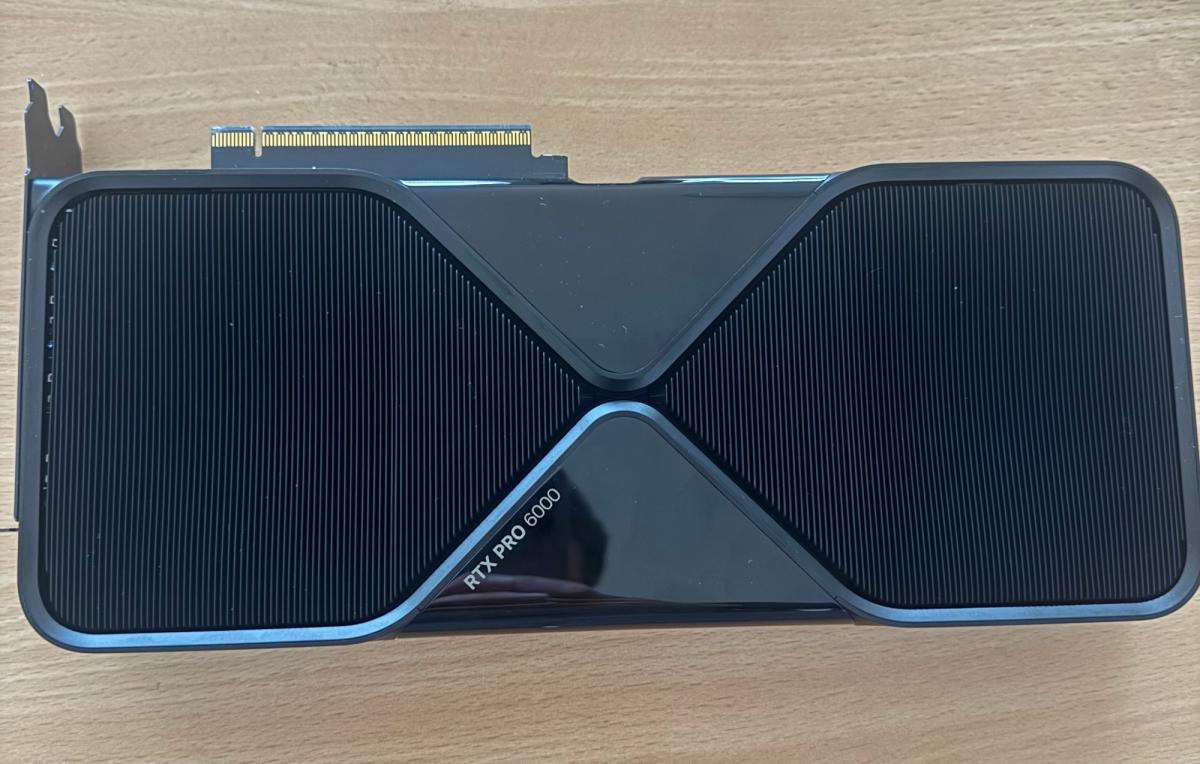

Auf so einer Grafikkarte lassen mittelständische Unternehmen ihre KI lokal laufen.

Wie ist der Stand lokaler KI wirklich?

Wer die Entwicklung der letzten Jahre verfolgt hat, sieht vor allem eines:

Lokale Modelle sind schnell besser geworden.

Ein wichtiger Startpunkt waren die ersten großen LLaMA-Modelle von Meta im Jahr 2023.Damit wurde zum ersten Mal sichtbar, dass starke Sprachmodelle nicht zwangsläufig nur als Blackbox-API existieren müssen.

Ende 2024 kamen dann verstärkt chinesische Modelle auf den Markt, die preislich teilweise drastisch günstiger waren als vergleichbare Closed-Source-Modelle.

Das Problem damals:Viele dieser Modelle waren zwar spannend, aber für echtes lokales Hosting oft noch zu groß.

Ein Beispiel:Ein Modell wie DeepSeek R1 in voller Größe lokal zu betreiben, hätte schnell Hardwarekosten im Bereich mehrerer hunderttausend Euro bedeutet.

Also technisch interessant - aber für viele Unternehmen operativ noch keine vernünftige Option.

Danach hat sich die Entwicklung jedoch spürbar verschoben.

Stärkere kleinere Modelle kamen auf den Markt.Und plötzlich war nicht mehr nur die Frage relevant, ob ein Modell „irgendwie lokal läuft“, sondern ob es lokal wirklich produktiv nutzbar ist.

Genau da wird es spannend.

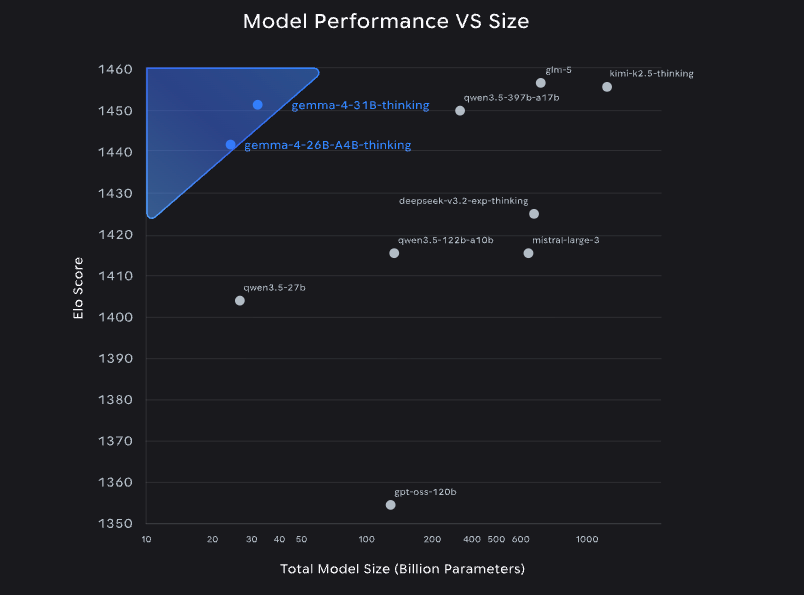

Denn aktuelle Modelle wie Gemma 4 oder auch Qwen 3.5 laufen inzwischen selbst auf deutlich zugänglicherer Hardware erstaunlich schnell.

Teilweise sogar auf Geräten, die nicht wie Rechenzentrums-Hardware aussehen, sondern eher wie ein gut ausgestattetes Arbeitsgerät.

Gemma 4 läuft auch in großen Ausführungen problemlos auf einem aktuellen MacBook Pro.

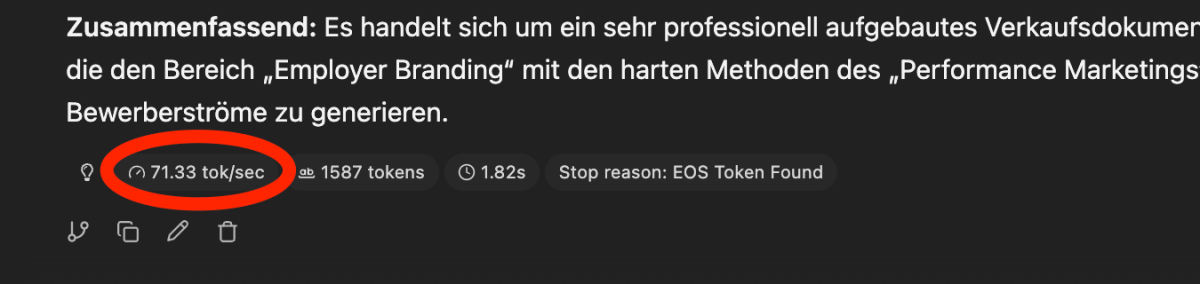

Bei Solbach Datentechnologie GmbH läuft Gemma 4 beispielsweise lokal auf einem MacBook bereits sehr brauchbar. Auf stärkerer Hardware wie einer RTX Pro 6000 liegen wir bei rund 200 Tokens pro Sekunde in produktiven Extraktionsaufgaben.

Das ist keine Spielerei mehr.

Das ist ein Punkt, an dem aus „lokaler KI“ plötzlich eine echte Infrastrukturentscheidung wird.

Warum das relevant ist

Vor 2-3 Jahren war lokale KI oft noch:

- spannend für Experimente

- nett für Demos

- oder sinnvoll für einzelne Spezialfälle

Heute ist das in vielen Bereichen deutlich anders.

Die Modelle sind:

- kleiner geworden

- effizienter geworden

- günstiger geworden

- und gleichzeitig viel näher an die Closed-Source-Modelle herangerückt

Nicht in jedem Use Case.Nicht für jede Aufgabe.Aber deutlich stärker, als viele Unternehmen überhaupt mitbekommen haben.

Die Gemma 4 Modell-Reihe zeigt auch auf kostengünstiger Hardware gute Leistung: https://deepmind.google/models/gemma/gemma-4/

Gerade bei Aufgaben wie:

- Extraktion

- Recherche

- Klassifikation

- Dokumentenverarbeitung

- internen Wissenssystemen

- strukturierten Analyseprozessen

sind lokale Modelle heute viel ernster zu nehmen als noch vor kurzer Zeit.

Wo lokale KI wirklich Sinn ergibt

Lokale KI lohnt sich vor allem in zwei Fällen.

1. Wenn sensible Daten verarbeitet werden

Das ist der offensichtlichste Fall.

Sobald es um sensible Kunden-, Prozess- oder Projektdaten geht, stellt sich automatisch die Infrastrukturfrage.

Ein Beispiel aus unserer Praxis:Wir haben Kunden, bei denen bereits die Datenlage so sensibel ist, dass eine zusätzliche Anreicherung über amerikanische KI-Provider schlicht keine gute Idee ist.

Wenn ein Unternehmen etwa als Contractor im Defense-Umfeld arbeitet, ist es operativ einfach unklug, sensible Kundendaten reflexhaft über US-Modelle laufen zu lassen.

Nicht weil amerikanische Modelle grundsätzlich „schlecht“ wären.Sondern weil hier Infrastruktur, Datenhoheit und Risikosteuerung plötzlich wichtiger werden als Bequemlichkeit.

In solchen Fällen ist lokale KI nicht Nice-to-have.

Sondern schlicht die vernünftigere Architekturentscheidung.

2. Wenn sehr viele Anfragen verarbeitet werden müssen

Der zweite Fall ist wirtschaftlicher Natur.

Sobald sehr viele KI-Anfragen verarbeitet werden, kann eigene oder kontrollierte Infrastruktur schnell attraktiv werden.

Warum?

Weil dann nicht mehr nur Modellqualität zählt, sondern auch:

- Kosten pro Anfrage

- Latenz

- Planbarkeit

- Abhängigkeit von externen APIs

- Kontrolle über Durchsatz

Gerade in datenlastigen Pipelines kann das ein massiver Hebel sein.

Bei Solbach Datentechnologie GmbH nutzen wir lokale Modelle inzwischen auch für Teile unserer eigenen Extraktionsaufgaben in der Lead-Recherche.

Also nicht für hübsche Demo-Tasks, sondern für produktive Prozesse, die realen Output erzeugen.

Genau dort sieht man schnell:Wenn Aufgaben häufig genug vorkommen und strukturiert genug sind, wird lokale KI wirtschaftlich und operativ sehr interessant.

Wo lokale KI eher keinen Sinn ergibt

So wichtig das Thema ist - lokale KI ist nicht automatisch überall die beste Lösung.

1. Für simple Automationen oft overkill

Wenn es um einfache Standardautomationen geht, ist lokale KI oft gar nicht die beste Antwort.

Viele Aufgaben lassen sich viel einfacher lösen mit:

- klassischer Softwarelogik

- APIs

- Skripten

- Workflows

- festen Regeln

Nicht jede Aufgabe braucht überhaupt ein Modell. Und nicht jede modellbasierte Aufgabe braucht direkt Self-Hosting.

2. Bei extremen Lastspitzen oder stark schwankendem Bedarf

Lokale KI ist auch nicht immer ideal, wenn sehr starke Peaks abgefangen werden müssen.

Denn dann muss die entsprechende Hardware vorgehalten werden.

Das heißt:

- Kapazität muss bezahlt werden

- auch wenn sie gerade nicht durchgehend ausgelastet ist

Für volatile Lastprofile kann Cloud-Inference deshalb weiterhin sinnvoll sein.

Gerade wenn:

- der Bedarf stark schwankt

- viele Anfragen nur sporadisch auftreten

- oder Spitzen sehr unregelmäßig kommen

Dann ist externe Infrastruktur oft flexibler.

Der eigentliche Denkfehler vieler Unternehmen

Die Debatte wird häufig falsch geführt.

Oft klingt es so, als gäbe es nur zwei Wege:

- entweder alles über Closed-Source-APIs in der Cloud

- oder komplett selbst betriebene High-End-Infrastruktur

In der Praxis gibt es aber viele Zwischenstufen.

Zum Beispiel:

- eigene Hardware

- gemietete dedizierte GPU-Server

- private Inference-Umgebungen

- offene Modelle über kontrolliertere Hosting-Partner

- hybride Architekturen mit lokaler und externer Inference

Die eigentliche Frage lautet deshalb nicht:

Cloud oder lokal?

Sondern eher:

Welche Architektur passt zum konkreten Use Case, zur Sensibilität der Daten und zur Laststruktur?

Genau dort trennt sich saubere Infrastrukturarbeit von KI-Marketing.

Warum das Thema gerade jetzt so relevant wird

Was derzeit fast am verrücktesten ist:

Open Models sind nicht mehr nur die B-Lösung für Datenschutzromantiker.

Sie werden in vielen Bereichen zu einer ernsthaften, produktiven Alternative.

Und das ist auch deshalb relevant, weil gute Modelle heute auf immer kostengünstigerer Hardware laufen.

Der Trend ist klar:

- bessere Effizienz

- kleinere Modelle

- mehr Leistung pro Hardware-Euro

- weniger Zwang zur riesigen Spezialinfrastruktur

Genau das macht lokale KI für den Mittelstand plötzlich realistisch.

Nicht überall. Nicht für alles. Aber oft dort, wo es vor kurzem noch unvernünftig gewesen wäre.

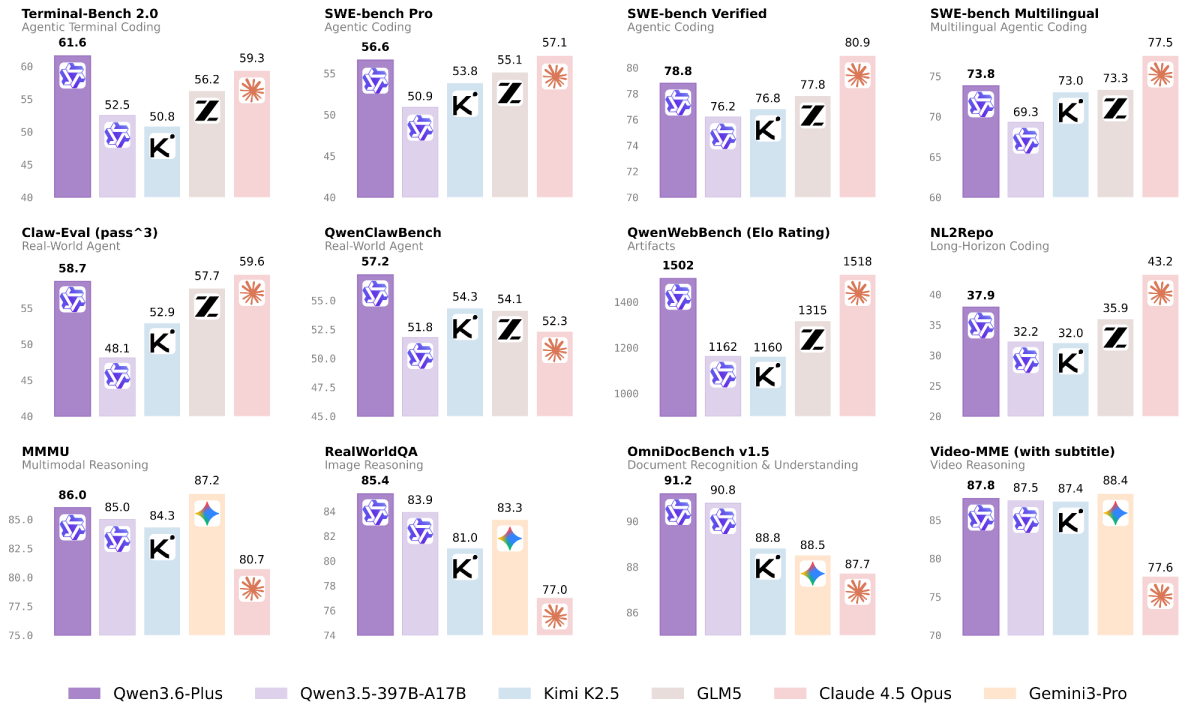

Auch Qwen 3.6 eine sehr wettbewerbsfähige Leistung. Quelle: https://qwen.ai/blog?id=qwen3.6

Unser Fazit aus der Praxis

Lokale KI lohnt sich vor allem dann, wenn:

- sensible Daten verarbeitet werden

- hohe Anfragevolumina anfallen

- wiederkehrende produktive Aufgaben automatisiert werden

- Datenhoheit und Infrastrukturkontrolle wichtig sind

- Cloud-Abhängigkeit bewusst reduziert werden soll

Weniger sinnvoll ist sie meist:

- für simple Automationen

- bei sehr starken Lastspitzen

- oder wenn der Use Case wirtschaftlich noch zu klein ist

Bei Solbach Datentechnologie GmbH war das keine theoretische Frage, sondern eine ganz praktische.

Für einen Kunden mit besonders sensiblem Datenumfeld haben wir Teile der Recherche- und Extraktionslogik bewusst auf lokal laufende Modelle umgestellt. Nicht aus Prinzip, sondern weil es in diesem Fall die sauberere Infrastrukturentscheidung war.

Gerade wenn sensible Daten verarbeitet werden und gleichzeitig wiederkehrende produktive Aufgaben anfallen, kann lokales Hosting heute sehr sinnvoll sein.

Genau deshalb ist lokale KI aus unserer Sicht weder Allheilmittel noch Spielerei, sondern vor allem eins: Eine technische Entscheidung, die zum Use Case passen muss.

Du willst diese Logik auf deinen Vertrieb anwenden? Dann starte mit einer konkreten Zielgruppenbeschreibung und prüfe danach, welche Recherche- und Qualifizierungsschritte dein System übernehmen muss.

Termin für Research-System anfragenWenn das resoniert hat

Mehr Pipeline entsteht durch präzisere Auswahl, nicht durch mehr Volumen.

Wir bauen Research-Strecken für DACH-B2B-Teams, die genau das operativ aufsetzen wollen. Wenn ihr eure Zielgruppen schärfer fassen oder eure CRM-Bestände besser priorisieren wollt, sprechen wir.

Weiterlesen

Verwandte Artikel

Lead-Recherche und Akquise

5 Symptome, dass dein Vertriebsproblem nicht die Ansprache, sondern die Leads sind

Viele Unternehmen schauen bei stagnierenden oder schwachen Vertriebsergebnissen zuerst auf die falsche Stelle.

Artikel lesenICP und Targeting

Zielgruppe trumpft alles

In der Kaltakquise entscheidet sich in den ersten Sekunden, ob ein Gespräch stattfindet oder nicht. Essentiell ist, ob der Entscheider am anderen Ende sofort denkt: Das betrifft mich. Und genau diese Relevanz…

Artikel lesen